1. 베이즈 통계학

베이즈 정리를 이해하기 전에 "조건부 확률"에 대한 개념을 이해해야 한다.

조건부 확률은 고등학교 때 배운 수학 개념이다.

2. PyTorch

- Numpy + AutoGrad + Function인 Deep Learning 프레임워크

- Numpy 구조를 가지는 Tensor 객체로 array 표현

- 자동미분을 지원하여 DL 연산을 지원

- 다양한 형태의 D을 지원하는 함수와 모델을 지원함

※ 추천서 : PyTorch로 시작하는 딥 러닝 입문

※ VS Code와 Google Colab을 연동하는 방법이 있으니 참고

3. 뉴럴 네트워크

- 뉴럴 네트워크(Neural Networks) : 동물의 뇌를 구성하는 생물학적 신경계에서 추상화하고 모방된 컴퓨팅 시스템(Computing System)

- 뉴럴 네트워크는 비선형 연산의 반복이 일어나는 모델이다.

예)

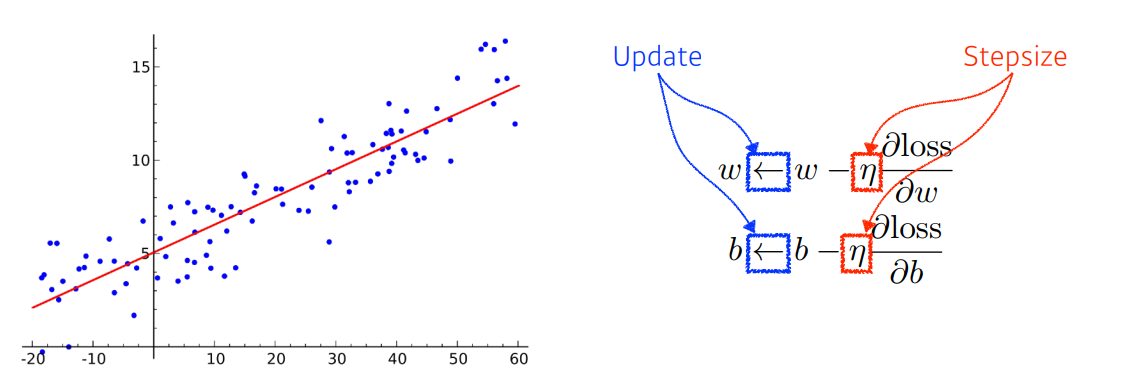

다음과 같은 모델(선형 회귀)이 있다고 하자

Data : N개의 데이터

Model : x를 매핑하여 y를 찾는 것이 목표

Loss : 우리가 이루고자 하는 현상이 이루어졌을 때, 줄어드는 함수

yi : i 번째 데이터 출력값, 즉 target yi^ : 모델의 출력값

Loss function을 각각 편미분할 때 음수방향으로 업데이트 하게되면 위 식과 같이 Loss가 최소화된다.

따라서, 위의 식처럼 Loss Function의 편미분값을 빼주어 최솟값을 찾기위해 w(가중치)와 b(편향값)을 업데이트 하는 것이다.(Gradient Descent)

Stepsize를 너무 크게 잡으면 학습이 아예되지 않고, 작게 잡으면 유효한 학습이 이루어지지 않는다.

1차원 뿐만 아니라, 다차원에서도 다룰 수 있다. 이를 이용하려면 행렬을 써야한다.

{W,b} : W(Weight)와 b(biase)를 통해 입력 X를 y라는 출력을 보내겠다.

h : hidden layer

한 번 선형결합이 반복되면 활성화 함수를 통해 비선형 변환을 한 것을 다시 선형변환, 비선형 변환을 n번 반복하면 더 많은 표현력을 가진다.(Nonlinear transform의 예 : sigmoid, tanh, ReLU)

4. MLP(Multi-Layer Perceptron : 다중 신경망)

아래 그림과 같이 Perceptron이 중첩된 모습을 말한다.

※ CE : Class Entropy Loss Function -> 분류 문제를 풀 때, 나온 값이 크던 작던 관계가 없다 하나를 제외한, 나머지의 값보다 월등히 크게 나왔을 때, 분류가 잘된 것으로 볼 수 있다.

'BoostCamp AI Tech - U Stage' 카테고리의 다른 글

| BoostCamp AI Tech - Day13 (0) | 2021.02.04 |

|---|---|

| BoostCamp AI Tech - Day12 (0) | 2021.02.02 |

| BoostCamp AI Tech - Day10 (0) | 2021.02.01 |

| BoostCamp AI Tech - Day09 (0) | 2021.01.28 |

| BoostCamp AI Tech - Day08 (0) | 2021.01.27 |

댓글